最新ISO42001人工智能管理体系详解

ISO/IEC 42001 是国际标准化组织(ISO)和国际电工委员会(IEC)联合发布的首个专门针对人工智能(AI)管理体系的标准。该标准旨在帮助组织建立、实施、维护和改进人工智能管理体系(AIMS),确保AI系统的开发、部署和使用的可信性、透明性、安全性和合规性。以下是对该标准的全面深入解析:

一、标准背景与目标

背景

随着AI技术快速渗透到各行业,其潜在风险(如伦理问题、隐私泄露、算法偏见、安全漏洞等)引发全球关注。

现有管理体系(如ISO 27001信息安全、ISO 9001质量管理)无法完全覆盖AI特有的技术和管理需求。

ISO/IEC 42001的制定填补了AI治理领域的国际标准空白,为组织提供系统性框架。

目标

可信AI:确保AI系统的可靠性、透明性和问责性。

风险管理:识别、评估和应对AI全生命周期的风险。

合规性:满足全球AI相关法规(如欧盟《AI法案》、中国《生成式AI管理办法》等)。

利益相关方信任:增强用户、客户和监管机构对AI应用的信心。

二、核心原则与适用范围

核心原则

透明性:AI决策过程可解释,避免“黑箱”操作。

公平性:消除算法偏见,确保公平对待所有群体。

隐私保护:符合数据保护法规(如GDPR)。

安全性:防范恶意攻击和数据泄露。

问责制:明确AI开发、部署和使用中的责任主体。

可持续性:考虑AI对环境和社会的影响。

适用范围

行业:适用于所有使用AI技术的组织(如医疗、金融、制造、公共服务等)。

技术类型:涵盖机器学习、深度学习、生成式AI、自动化决策系统等。

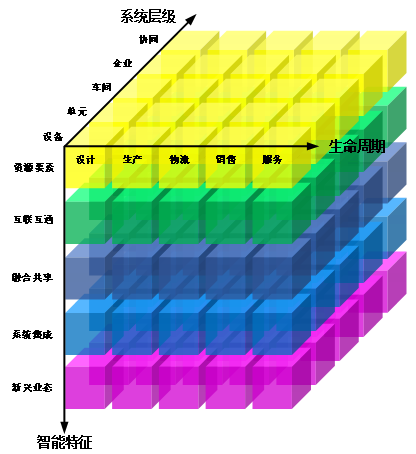

生命周期:覆盖AI系统的设计、开发、训练、部署、监控和退役阶段。

三、标准框架与核心条款

ISO/IEC 42001采用高阶结构(HLS),与其他ISO管理体系标准(如ISO 27001)兼容,便于整合。其核心框架包括以下部分:

1. 组织环境(Context of the Organization)

内外部因素分析:识别与AI相关的法律法规、技术趋势、利益相关方需求。

风险与机遇:评估AI对组织目标的影响,制定应对策略。

2. 领导作用(Leadership)

管理层承诺:确保资源投入,建立AI治理文化。

AI政策:制定符合伦理和法规的AI战略目标。

3. 规划(Planning)

风险管理:建立AI风险框架,包括数据质量、模型偏差、安全漏洞等。

目标与指标:设定可量化的AI绩效指标(如准确率、公平性评分)。

4. 支持(Support)

资源管理:提供技术基础设施、数据资源和专业人才。

能力建设:培训员工AI伦理、技术能力和合规意识。

沟通机制:确保内外部信息透明(如向用户披露AI使用情况)。

5. 运行(Operation)

AI开发控制:规范数据采集、模型训练、测试验证流程。

变更管理:跟踪AI系统更新对性能和风险的影响。

应急响应:制定AI系统故障或安全事件的应急预案。

6. 绩效评价(Performance Evaluation)

监控与测量:持续评估AI系统的准确性、公平性和安全性。

内部审计:定期检查AI管理体系的有效性。

管理评审:高层定期审查体系运行情况,推动改进。

7. 改进(Improvement)

纠正措施:针对问题(如算法偏见)进行根源分析并整改。

持续优化:基于反馈和技术进步迭代升级AI系统。

四、关键实施步骤

差距分析:对比现有管理体系与ISO/IEC 42001要求。

建立AI治理团队:跨部门协作(技术、法务、合规、业务)。

制定AI政策与流程:明确开发、部署和监控的标准化操作。

风险管理与文档化:记录风险评估结果和控制措施。

培训与意识提升:全员参与AI伦理与合规培训。

内部审核与认证:通过第三方认证机构审核。

五、认证流程

准备阶段:完成体系建立并运行至少3个月。

第一阶段审核:文件审查,确认体系符合标准要求。

第二阶段审核:现场审核,验证体系运行有效性。

认证决定:通过后颁发证书,有效期3年,需定期监督审核。

六、挑战与应对

技术复杂性

挑战:AI模型可解释性低、数据依赖性强。

应对:采用可解释AI(XAI)工具,加强数据治理。

法规动态性

挑战:各国AI法规快速更新。

应对:建立法规跟踪机制,与法务部门紧密协作。

资源投入

挑战:需投入大量技术、人力和资金。

应对:分阶段实施,优先处理高风险领域。

七、行业应用案例

医疗行业:确保AI辅助诊断系统的准确性和患者隐私保护。

金融行业:防范信贷评估模型的算法歧视风险。

制造业:监控AI驱动的自动化生产线安全性和可靠性。

八、未来展望

ISO/IEC 42001将与AI技术发展同步更新,未来可能涵盖以下方向:

生成式AI(如ChatGPT)的版权和内容安全管控。

边缘计算与AIoT(人工智能物联网)的融合管理。

量子计算对AI模型的潜在影响。

总结

ISO/IEC 42001为组织提供了系统化的AI治理框架,不仅帮助规避风险,还能提升AI应用的商业价值和社会信任。实施该标准需结合组织实际,注重技术、管理与伦理的平衡,最终实现负责任的人工智能创新。

服务热线

服务热线